欧盟委员会近期发布政策文件《欧盟人工智能》,尽管欧盟人工智能战略姗姗来迟,但在技术和产业不占优势的情况下,欧盟人工智能战略的重头戏放在了人工智能价值观,希望以此彰显欧盟发展人工智能的独特优势。欧盟秉持以人为本的人工智能发展理念,希望通过人工智能价值引导人工智能发展,塑造其社会影响,造福个人和社会。

在欧盟看来,人工智能一方面使我们的生活更加便捷和高效,比如虚拟的个人助手、自动驾驶汽车、自动化推荐等,另一方面有助于解决人类社会面临的重大挑战,比如治疗癌症、减少交通事故伤亡、减少饥饿和贫困、应对网络安全攻击等。正如蒸汽机和电力一样,人工智能正在重塑我们的世界、社会和工业。算力的提高、数据的积累以及算法的进步使人工智能成为本世纪最具战略性的技术之一。我们发展人工智能的方式和路径将重塑我们生活在其中的世界。为此,欧盟需要一个坚实的人工智能战略框架,确保发展和应用人工智能增进社会福祉,赋能所有人。

欧盟委员会提出的欧盟人工智能战略包括三大支柱:其一,发展欧盟在人工智能领域的技术和产业能力并促进人工智能技术向整个经济领域渗透,不仅仅是私营部门,也包括政府等公共部门;其二,迎接社会经济变革,需要让教育和培训体系跟上时代发展,密切监测劳动力市场的新变化,培育新的人才,支持过渡期劳动者并调整社会保障系统;其三,确保欧盟具有与人工智能发展及应用相适应的伦理和法律框架,包括阐明产品责任规则的适用,仔细研究人工智能技术带来的新挑战和新问题,通过欧洲AI联盟促进利益相关方交流合作,从而制定出人工智能伦理指南。

使人工智能广泛渗透

为了加快提高欧盟的人工智能能力并使其尽快渗透到各行各业,欧盟将从以下七个方面着手:

加大政府投资。公共投资方面,根据“地平线2020”(Horizon 2020)研发及创新计划,到2020年年底,欧盟将投入大约15亿欧元,同一时期通过公私合作计划还将投入25亿欧元。

促进科技成果从实验室走向市场。欧盟将大力支持能够开创新市场的技术创新和突破,比如人工智能技术。这可以通过欧盟创新委员会的试点项目来实现。

打造世界级的欧洲人工智能研究中心。当前,各成员国已经在建设以人工智能技术为重心的研究中心,在此基础上,欧盟还将大力扶持高标准人工智能研究中心的建设,并促进激励相关研究机构在研究方面沟通合作,共享成果,共同发展。

使中小企业和潜在用户从人工智能技术中受益。欧盟将避免人工智能技术扩大数字鸿沟。只有所有人都能获取技术并从中获益,欧盟才能真正实现人工智能技术的社会潜力。

支持人工智能技术测试和实验。对人工智能产品进行测试和实验是其进入市场前的必备环节,确保其符合安全标准和规则,并使政府决策者能够对新技术形成更好的认知以便制定合适的法律框架。

吸引私人投资。充分的私人投资对于实现人工智能变革极为关键。为此,欧盟将持续吸引私人投资,支持人工智能研发和行业应用。

加强数据开放共享。开发人工智能系统需要大量的数据,数据是机器学习的关键,为此,需要促进数据的开放和共享。过去15年,欧盟已经推出多项举措促进公共部门数据和公共资金资助的研究成果的开放与再利用。

积极应对社会经济变革

欧盟在人工智能时代面临三项挑战:一是帮助整个社会做好迎接人工智能时代的准备;二是帮助因人工智能的发展而可能失业或者更换职业的人,与欧洲社会权利协会一起为过渡期劳动者提供完善的社会保障;三是需要培养人工智能专业人才,吸引国外相关人才。

消除数字鸿沟,为每个人提供所需的数字技能。欧盟在2014~2020年期间预计投入270亿欧元支持技能培养,其中23亿欧元专门用于培养数字技能,可以与私营部门合作提供数字技能培训项目。

培养多元的、跨学科的人才。人工智能带来了新的工作,总体而言,欧盟信息和通信技术专家数量自2011年以来每年增长5%,创造了180万个就业机会,并在短短五年内迅速将其总就业份额从3%增加到3.7%。2018年欧盟在就业和教育政策方面将推出以下举措:一是推出专门的培训和再培训计划,为受自动化威胁的专业人员提供新技术培训项目;二是监测劳动力市场变化及欧盟范围内的技能缺口,尤其是需要监测人工智能对劳动力市场的影响并提出建议;三是为学生和毕业生提供高级数字技能培训项目;四是鼓励校企合作,吸引更多人工智能人才;五是邀请社会合作伙伴在其联合工作计划中关注人工智能及其对就业和经济的影响,以及人工智能工作岗位多元化和性别平衡的重要性。

建立适当的伦理和法律框架

发展和应用人工智能需要一个良好的环境,至少包括信任和责任。当前,欧盟已经有了一些基本的法律框架。比如欧盟基本权利宪章,较高的安全和产品责任标准,以及保护个人数据的GDPR(一般数据保护条例)等。此外,为了增进公众信任,人们还需要理解技术如何运作,这就要求人工智能系统具有可解释性,以便人类可以理解系统的行为。如其他技术一样,人工智能也是一把双刃剑,既可被用来服务于个人和社会的利益,也可能被滥用,具有安全、责任、网络安全、偏见、歧视等风险。因此,需要考虑建立适当的伦理和法律框架,以便为技术创新提供法律的确定性,实现技术创新和人权保护的平衡。

起草并制定人工智能伦理指南。欧盟委员会将邀请所有的利益相关方一起探讨人工智能伦理原则的起草和制定。人工智能伦理指南将回应人工智能工作影响、公平、安全、网络安全、社会包容、算法透明等诸多问题。此外,还将关注人工智能对基本权利(比如隐私、尊严、消费者保护、禁止歧视等)的影响。

评估安全和责任法律框架。当前,欧盟委员会正在评估当前的安全和责任法律框架是否足以应对人工智能带来的法律挑战,是否存在需要予以解决的法律空白。

充分赋能个人消费者。个人应能知悉人工智能产品的用途、性能和特征,对使用人工智能产品过程中产生的数据享有控制权,并有权知道是在与人类还是在与机器人交流。尤其是当个人与自动化系统交流时,需要告知用户如何向人类求援,以及如何纠正或审查系统的决定。

建立多方合作机制,共同应对挑战。一是成员国之间加深合作;二是融入利益相关方,建立欧洲人工智能联盟;三是监测人工智能发展和应用情况;四是开展国际合作。(曹建峰 付一方)

转自:人民邮电报

相关阅读

猜您喜欢

- 令人失望的增长!可能在下面的估计值为2.7%

- 最高经济的日常报新闻 - 2015年7月9日

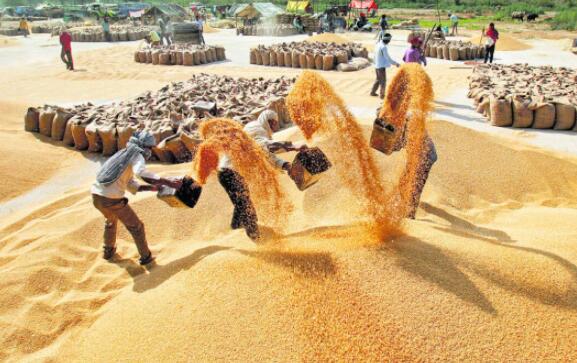

- CCEA批准建立Agritech基础设施基金;卢比的分配预算。200亿卢比

- 中心的目标是在未来四个月内创建一个包含8000万农民的数据库

- GAIL进军制氢领域 扩大其可再生能源产品组合

- Manpasand饮料在折扣亮相时交易

- Goldstone Infra Rallies 6%;计划出售聚合物绝缘人司

- 最佳公司新闻 - 2015年7月8日

- 沙特阿拉伯是俄罗斯的背后离开美国吗?

- Bandhan Bank宣布董事会,推出徽标

- 托马斯厨师获得收购额外的办公空间

- Aditya Birla Nuvo将进入太阳能

- 泰米尔纳德邦的BHEL佣金500 MW热量单位

- Sensex,漂亮的漂亮贸易略有

- 只有希腊救助促进了情绪

- 到来几周要注意什么?

图文推荐

热门文章

-

1

1这一周是:TCS,5家其他Sensex公司输了卢比。市场上限62,808 CR

原创 2021-09-07 20:52:08 -

2

2令人沮丧的IIP效应:卢比在弱者开始后丢失了更多的地面

原创 2021-09-07 19:52:11 -

3

3慢慢开始盈利; TCS美元收入增长降至4年的低点

原创 2021-09-07 18:52:11 -

4

4喷气式飞机飙升宣布折扣票价

原创 2021-09-07 17:52:07 -

5

5Unity Infraprojects问题卢比。82.63亿卢比股票,促销者

原创 2021-09-07 16:52:07 -

6

6商品交换成交量为16%以卢比。16.55千万卢比Q1

原创 2021-09-07 15:52:10